Öncelikle bu yazımızda tabii ki Facebook’tan ve yeniden oluşturmak için ne kadar token harcayacağımızdan bahsetmeyeceğim. Tahmin edebileceğiniz gibi bunu hesaplamak için matematikçilerle oturup hesap yapmamız gerek :D. Bu yazımda, AI’a yaklaşımım, nasıl kullandığım ve en sonda nasıl daha iyi verim aldığımdan bahsediyor olacağım.

Konumuza gelecek olursak; yapay zeka ile çalışan bir front-end developer için mesele artık sadece kod yazdırmak değil. Asıl farkı yaratan şey, tokeni nasıl kullandığın.

Çünkü bugün Facebook benzeri bir ürünü yeniden yapmaya kalktığında sorun genelde ilk ekranı çıkarmak olmuyor. Feed’i, profil sayfasını, yorum alanını ya da ayarlar ekranını bir şekilde oluşturuyorsun. Asıl mesele, bu süreci ne kadar düzenli yönettiğin.

İyi kullanılmayan token çok hızlı boşa gidiyor.

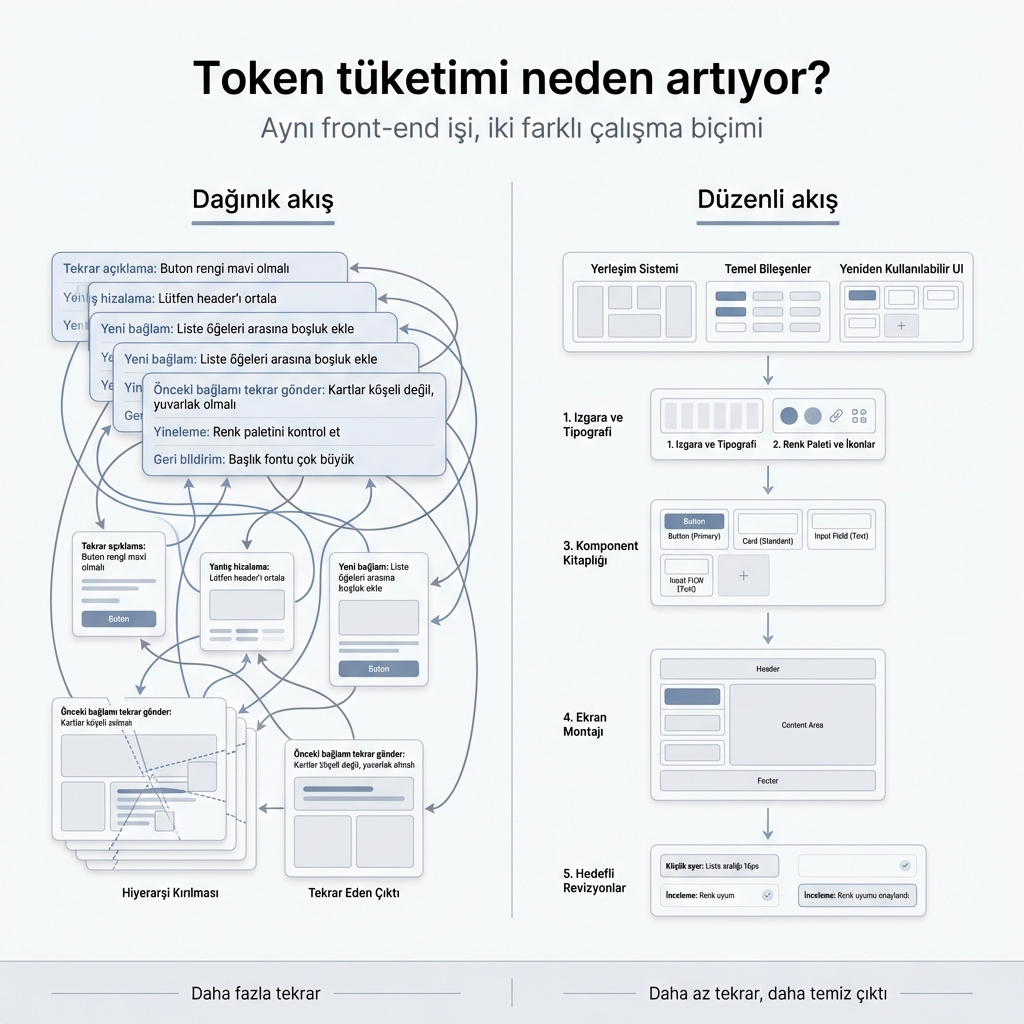

Bunu en basit haliyle şöyle düşünebiliriz: token tüketimi çoğu zaman kodun zorluğundan değil, çalışma biçiminden artıyor. Aynı işi dağınık şekilde ilerleyerek de yapabilirsin, daha sistemli şekilde de. Aradaki fark, hem çıkan sonucun kalitesinde hem de harcanan toplam token miktarında ortaya çıkıyor.

Özellikle de şunlar oluyorsa:

- her ekranda her şeyi baştan anlatıyorsan,

- component mantığını baştan kurmadan ilerliyorsan,

- bir ekranı 5 kez tamamen yeniden yazdırıyorsan,

- neyin değişeceğini net söylemeden modele bırakıyorsan,

- projeyi parça parça değil, tek seferde çözmeye çalışıyorsan.

Bir front-end developer için bence token yönetimi biraz component mantığına benziyor. Nasıl iyi bir arayüz küçük, tekrar kullanılabilir ve net parçalarla kuruluyorsa; AI ile çalışma düzeni de aynı şekilde kurulmalı.

Önce sistemi tarif etmek gerekiyor.

Sonra ekranları.

Sonra component’leri.

Sonra sadece değişecek kısmı.

Yani “bana Facebook yap” yaklaşımı yerine, daha kontrollü bir akış çok daha verimli:

- önce layout sistemi,

- sonra post card,

- sonra comment block,

- sonra profile header,

- sonra bildirim listesi,

- en son ekranları birleştirme.

Bu yaklaşım iki şey kazandırıyor:

Daha az tekrar ve daha temiz sonuç.

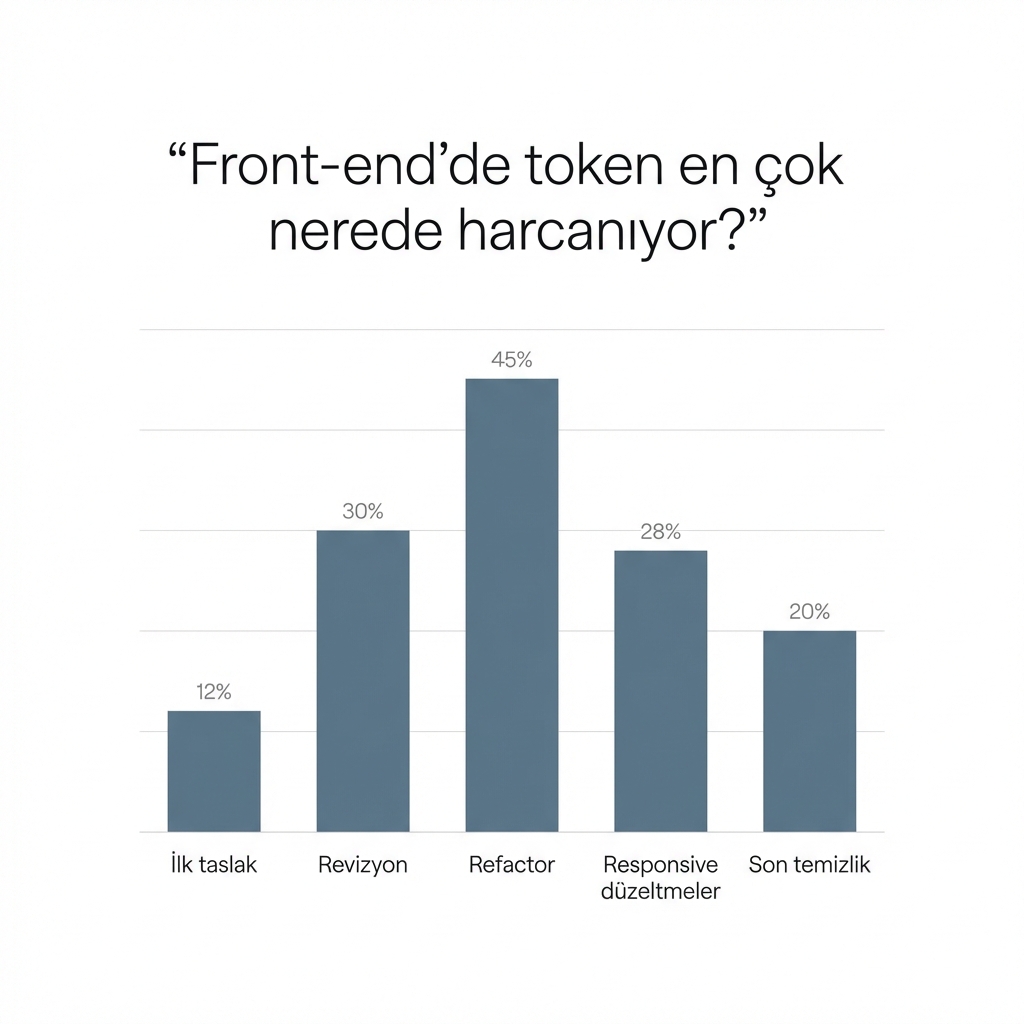

Bence front-end tarafında token en çok ilk üretimde değil, iterasyonda yanıyor. Çünkü ilk versiyon çoğu zaman çıkar. Ama sonrasında spacing düzelir, hiyerarşi değişir, component parçalanır, type’lar temizlenir, responsive yapı toparlanır. İşte gerçek tüketim burada başlar.

Özellikle front-end tarafında maliyet, ilk çıktıyı almaktan çok onu düzgün hale getirmeye çalışırken büyüyor. İlk taslak çoğu zaman hızlı geliyor; ama refactor, responsive düzeltmeler, component ayrıştırma ve son düzenlemeler işin asıl ağırlığını oluşturuyor. Token tarafındaki gerçek yük de genelde burada birikiyor.

O yüzden bugün Facebook benzeri bir ürünü yeniden yapmaya çalışsam, ilk sorum “kaç token harcarım?” olmazdı. Daha çok şu olurdu:

Bu tokeni nasıl daha akıllı kullanırım?

- büyük prompt yerine net küçük adımlar,

- ekran yerine önce component,

- tekrar tekrar anlatmak yerine standart yapı,

- her revizyonda tüm kodu değil, sadece ilgili parçayı taşıma,

- tasarım kararlarını baştan netleştirme.

Çünkü AI ile front-end geliştirmede verim, sadece iyi model kullanmaktan gelmiyor.

Biraz da düzenli düşünmekten geliyor.

Belki de yeni dönemde iyi geliştirici olmanın parçası şu olacak:

Sadece temiz kod yazmak değil, tokeni de temiz kullanmak.

Ben kendi tarafımda bunu genelde parçalara ayırarak ilerletiyorum. Bir ekranı ya da akışı tek seferde çözdürmeye çalışmak yerine önce yapıyı kurduruyorum, sonra tek tek parçaları ele alıyorum. AI’dan gelen ilk cevabı da olduğu gibi kabul etmiyorum; beğenmediğim yerleri tek tek listeleyip yeniden veriyorum. Eğer projede başka bir yerde benzer bir component ya da pattern kullandıysam, onu da referans gösteriyorum. Böylece her seferinde sıfırdan anlatmak yerine, mevcut yapının devamı gibi ilerlemek daha kolay oluyor. Sayfa tamamlandıktan sonra da dönüp kodu baştan kontrol ediyorum. Çünkü asıl kalite çoğu zaman ilk çıktıda değil, son kontrolde ortaya çıkıyor.

Leave a Comment